Google BERT je aktualizací vyhledávacího algoritmu. Jejím smyslem je lepší implementace transformátorů významu, a tím pádem vyšší porozumění vyhledávače přirozenému jazyku. Bude BERTík významný? A jak rychle penetruje jazykovou džungli?

BERT je modul strojového učení založený na obousměrném kódování reprezentací z transformátorů významu. Transformátory nazývá Google ty slova, která pozměňují význam ve větě – nikoliv ve smyslu dotazů jedno slovo za druhým, ale ve vztahu ke všem ostatním slovům ve větě,

upřesňuje Pandu Nayak, viceprezident vyhledávacích služeb. Modelování založené na BERT zvažuje kontext celé věty, zvláštní pozornost věnují tomu, co předchází a co následuje konkrétním slovům.

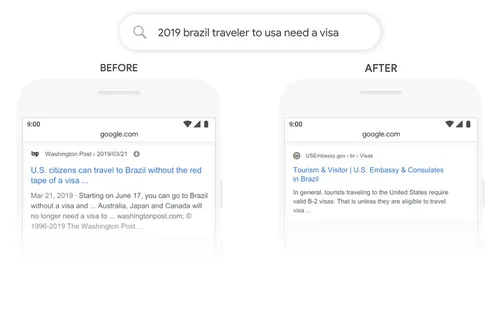

Nayak uvádí příklad 2019 brazil traveler to usa need a visa. Jestliže dříve Google vzal v potaz dotaz jako pel-mel slov, nyní dokáže identifikovat klíčový význam předložky to a hledá vztah ostatních slov k ní.

Dříve tedy Google odpovídal všemožnými výsledky, které zahrnovaly Brazílii, Američany, víza a cestování – typicky business výsledky cestovních agentur nabízejících americkým turistům destinace v Brazílii. BERT nyní způsobí, že je uchopen záměr cestovat do USA, získat vízum a cestovat z Brazílie.

Nayak exemplifikuje na dalších sekvencích:

can you get medicine for someone pharmacy

parking on a hill with no curb

math practice books for adult

A z nich vyplývá, že klíčové pozornosti se aktuálně – v angličtině – dostává vlastně předložkám, záporům – ale dokonce i kontextuálnímu významu (v posledním příkladu).

I když Google aktualizaci BERT prezentuje coby zásadní a přelomovou, lze se držet střízlivého odhadu, že jde jen o první krůčky v uchopování kontextu při konstrukci významu. Kromě negace významového okolí je právě kontext klíčový v procesu konstrukce významu – to už se ovšem dostáváme na pole sémiotiky. A právě to, že Nayak je viceprezidentem vyhledávače – nikoliv lingvistou či neurolingvistou – do jisté míry ospravedlňuje jeho marketingové nadšením BERTem.

Zásah BERT do reálného vyhledávání

BERT je aktuálně uvolňován na výsledky vyhledávání v angličtině. Google odhaduje, že aktuálně ovlivní 10 % vyhledávání v angličtině v USA. Další jazyky budou následovat bez upřesnění časového horizontu.

Ovlivněny bude jak hodnotící algoritmus výsledků (ranking), tak způsob vyhodnocující vhodný obsah pro rozšířené výsledky vyhledávání v podobě Featured Snippets.

A co BERT s češtinou?

Modelování BERT je prý natolik náročné, že Google musel nasadit Cloud TPU pody, aby mohl odpovídat na vyhledávací dotazy v reálném čase. Kdy můžeme očekávat ovlivnění české verze Googlu a jak si poradí s chuťovkami jazyků méně syntakticky svázaných než angličtina, budeme muset zjistit sami. Ale vsadím se, že některé české chuťovky zavaří i cloudové TPU Googlu.

BERT je sice historie, ale princip zůstává

Chápat, co byl BERT, je fajn. Byl přelomem své doby. Otevřel Googlu oči a naučil ho číst kapku víc jako člověk. Ale i v éře LLMs a AI zůstává základní princip, který BERT odstartoval: obsloužit uživatelský záměr.

Tupému cpaní KWs tedy odzvonilo a stejně tak praSEO. Jste-li připraveni místo toho obsloužit user-intent, zjistěte co všechno může nabídnout synergie rozličných činností: od kreativních taktik po globální strategii SEO.

Zdroje

- Blog Google

Expert na výkonově orientované SEO, Local Business SEO, datový a technický copywriting a budování brandu.

Mám za sebou tvrdou školu vlastního retailu, roky v online byznysu a dvě magisterská studia: psychologie a žurnalistiky.

Vím, co zákazník řeší váhaje nad peněženkou, a umím to přetavit v pozice a texty, které konvertují. Žádné teoretické poučky, ale postupy vybojované přímo v zákopech trhu.

Kdo je Daniel Beránek odhalíte v profesní etnografii Od pultu přes ZUR a PSY až k SEO a copy s ostrými hroty!